コンタクトセンターでも生成AIの導入が活発になっています。

コールセンター白書2024によると、コンタクトセンターにおける生成AIの導入率は2023年が5.1%だったのに対して、2024年は18.9%まで増えており、この1年で一気に導入が進んだことが分かります。さらに、50.2%の企業が「活用を検討中」と回答しており、今後も積極的な活用が期待されます。

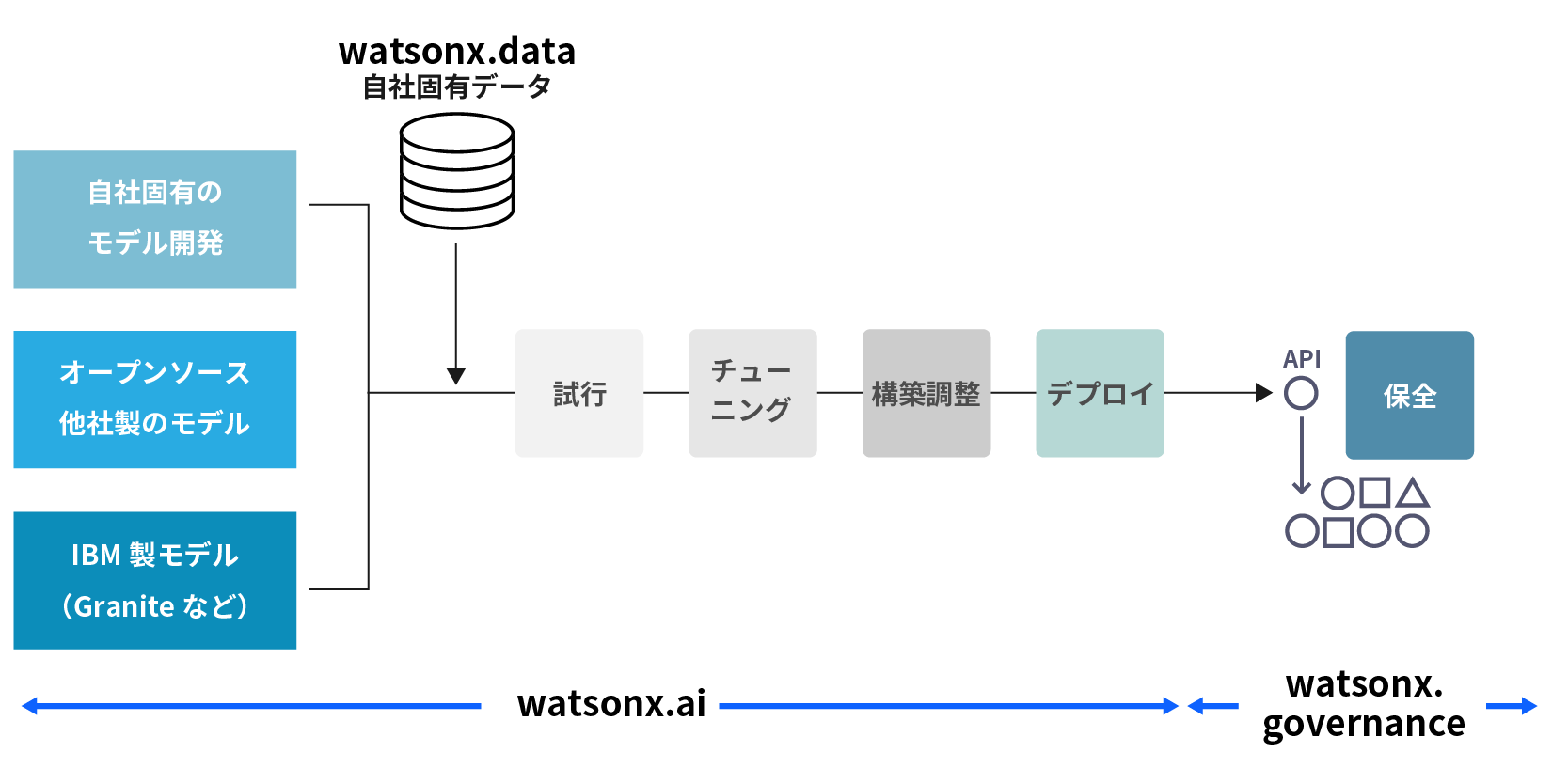

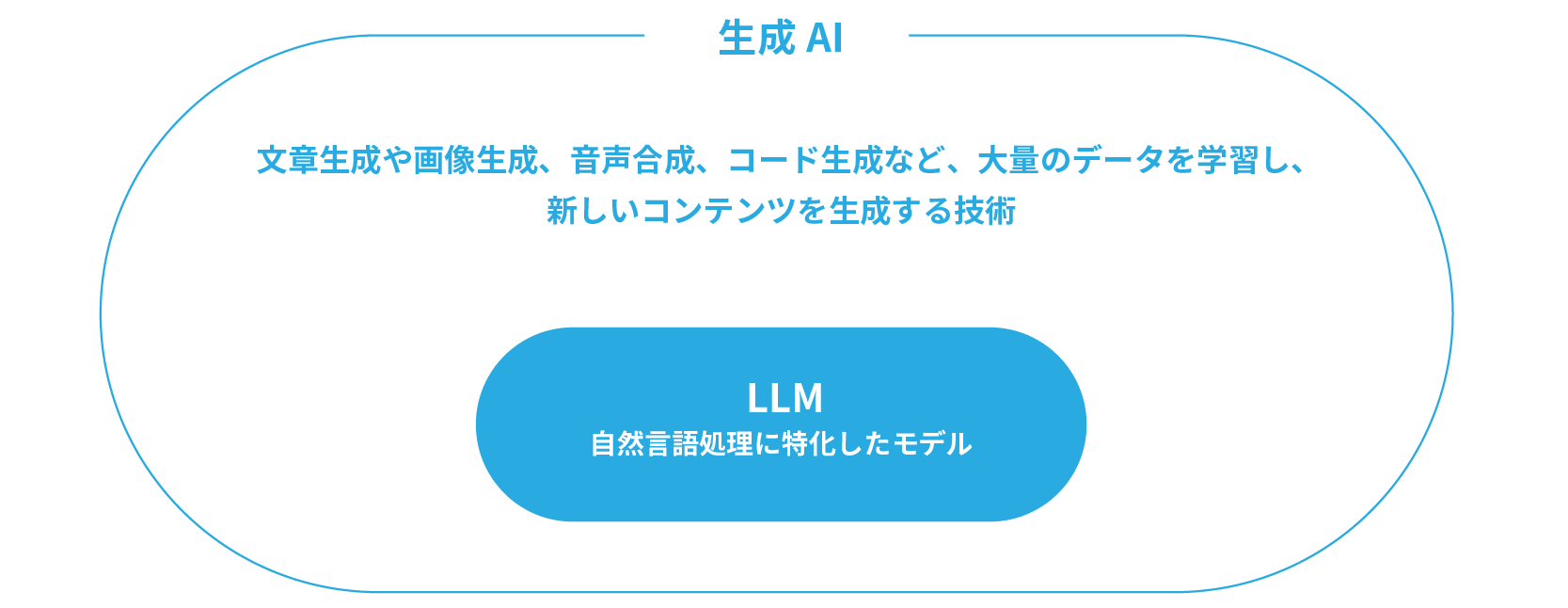

そこで今回は、業務で効果的に生成AIを活用するために生成AIとどう向き合っていくべきかについて、LLMに焦点を当てて解説していきます。